Streameři dostanou do rukou další nástroj pro kontrolu komunity.

Twitch zavádí pokročilé strojové učení, které pomůže s automatickým moderováním chatu. Funkce je mířena na problematické uživatele, kteří si po banu založí nový účet a pokračují v narušování komunity. O jejich odhalení a omezení se bude starat algoritmus založený na strojovém učení.

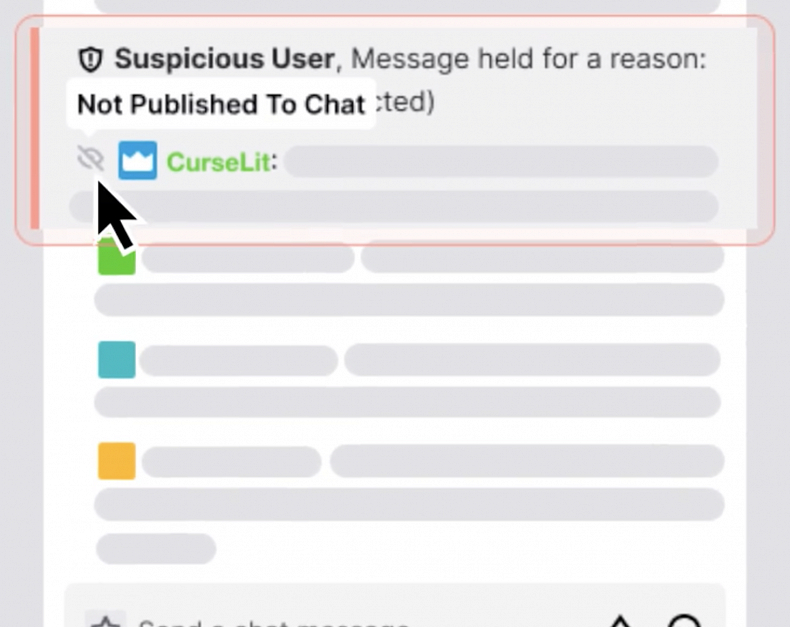

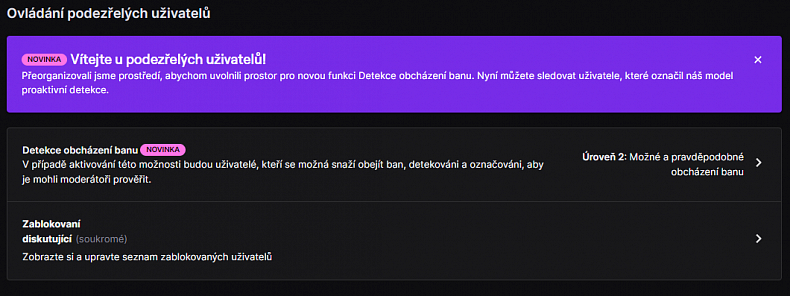

Detekce podezřelých uživatelů poháněná strojovým učením rozezná problematické diváky podle řady faktorů a Twitch přímo specifikoval, že se zaměří i na uživatele, kteří si zakládají po banu další účty.

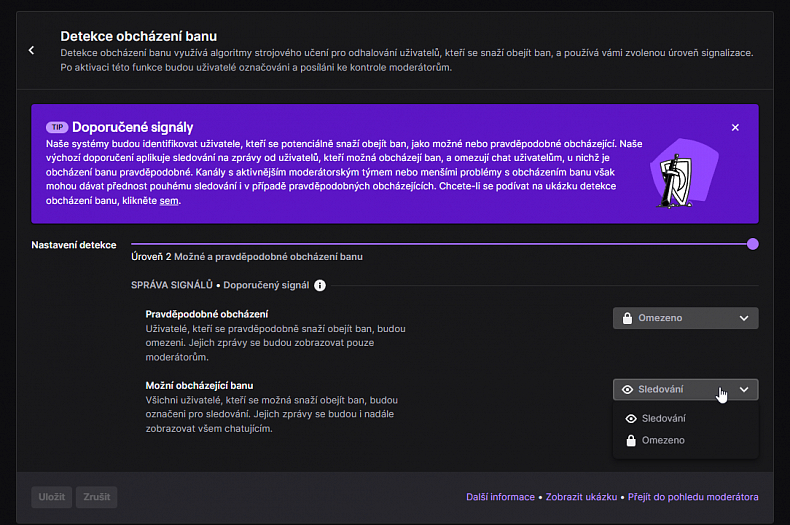

Algoritmus vyhodnocuje problematické jedince podle řady veřejné neznámých faktorů a rozřadí je do dvou kategorií - nejspíše a možná škodlivé.

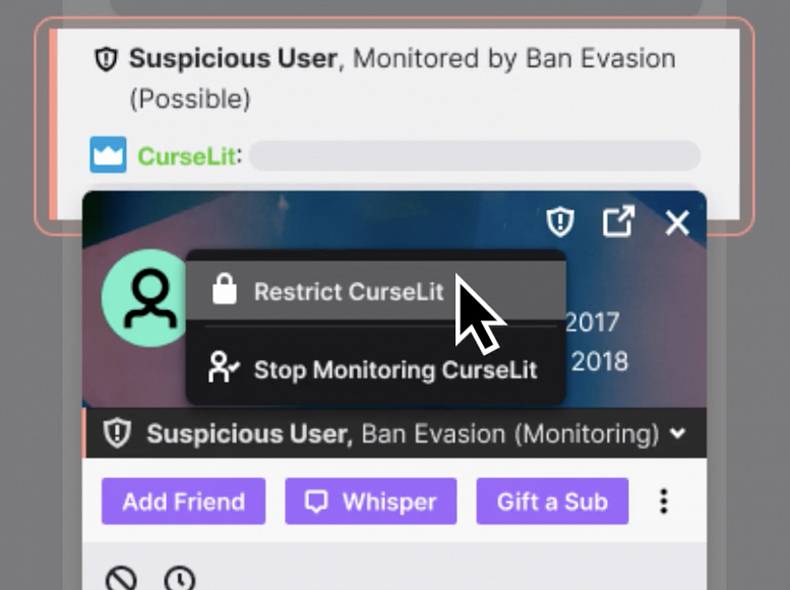

Nejspíše škodliví (likely) uživatelé si s ostatními moc nepopovídají. Jejich zprávu totiž Twitch okamžitě zadrží a streamer i moderátoři okamžitě uvidí, že jde o problematického diváka. Finální zabanování, nebo zrušení všech postihů je na moderátorech.

Možné (possible) škůdce komunitní zábavy systém nijak neomezí. Přesto moderátoři okamžitě uvidí, že systém uživatele vyhodnotil jako potenciálně problematické. Na lidech pak zůstává volba, zda na účet uvalí ban, či jiné omezení, nebo vypnou zmíněné označení.

Systém lze i upravovat. Streameři mohou nastavit, aby zprávy od obou skupin uživatelů byly zachyceny. Zároveň lze funkci zcela vypnout, ačkoliv bude v základu zapnuta všem kanálům.

Jelikož jde o algoritmus založený na strojovém učení, který kontroluje lidi, dojde k řadě omylů. Právě proto systém automaticky nebanuje uživatele a finální rozhodnutí nechává na lidech.